LICZBY NIE POLUJĄ

Na rynku termowizji jest dziś tłok jak na zbiorówce w szczycie sezonu. Każdy producent dorzuca kolejne liczby do specyfikacji, a przeciętny użytkownik ma wierzyć, że więcej znaczy lepiej. Tylko że tych parametrów nie da się sprawdzić „w polu”. Bo jak zweryfikować realne 15 mK NETD albo jakość przetwarzania obrazu bez komory klimatycznej z obiektami o stałej temperaturze i minimalnej różnicy wobec siebie wraz z wyszkolonymi inżynierami-fizykami? No właśnie.

Rynek w praktyce jest znacznie węższy niż się wydaje. Jeśli odliczymy tzw OEM-y, czyli takich co składają swoje produkty z podzespołów firm trzecich, to na palcach jednej ręki można policzyć graczy, którzy produkują mikrobolometry, czyli detektory podczerwieni. To absolutna podstawa i serce każdego termowizora! Wśród nich tylko część robi urządzenia end-to-end, od wafla po gotowy sprzęt. I co ważne, ci wiodący producenci bardzo pilnują swojej przewagi technologicznej. Efekt jest prosty: sprzęt składany zawsze będzie o krok za tym, co oferują marki rozwijające technologię u siebie.

Technicznie kluczowe są trzy rzeczy: rozdzielczość detektora, wielkość piksela (np. 12 µm vs 17 µm), oraz czułość termiczna, czyli NETD. Do tego dochodzi częstotliwość odświeżania i jakość optyki. I tu zaczyna się zabawa, bo sama rozdzielczość niczego nie gwarantuje. Ten sam sensor 384×288 może dać zupełnie inny obraz w zależności od toru optycznego i algorytmów do tego stopnia, że z modułu wyciągniemy bardzo dużo szczegółów.

Weźmy również na warsztat obiektyw termowizora. W urządzeniach premium stosuje się soczewki z germanu, który ma bardzo dobrą transmisję w paśmie LWIR. Tańsze konstrukcje idą w szkła tlenkowe albo mieszanki, które przy słabej optymalizacji modułu mogą mieć większe straty i gorszą przepuszczalność. Efekt? Mniej promieniowania cieplnego dociera do detektora, spada kontrast i szczegółowość. Przeciętnemu myśliwemu w zupełności to może wystarczyć do polowań, ale inni wolą widzieć nieco więcej.

Druga sprawa to sam detektor. Mikrobolometr to nie tylko „matryca pikseli”. Liczy się jednorodność, stabilność temperaturowa, kalibracja i elektronika odczytu. Kluczową kwestią w tym zakresie jest pierwiastek z jakiego został wykonany, bowiem komponent ten odpowiada za przetwarzanie promieniowania cieplnego na sygnał elektryczny. Najlepsze mikobolomentry to VOx- zbudowane z tlenku vanadu, zaś budżetowe rozwiązania bazują na krzemie, który w gorzej sobie radzi, szczególnie w słabych warunkach termicznych (duża wilgotność powietrza). Dodatkowo wiodący producenci selekcjonują matryce i rozwijają własne metody kompensacji szumów. Firmy niżej benchmarkowane lub skłądające tylko podzespoły często na papierze mogą dalej mieć 384 czy 640, ale obraz ma więcej szumu, gorszą dynamikę i słabszą separację detali.

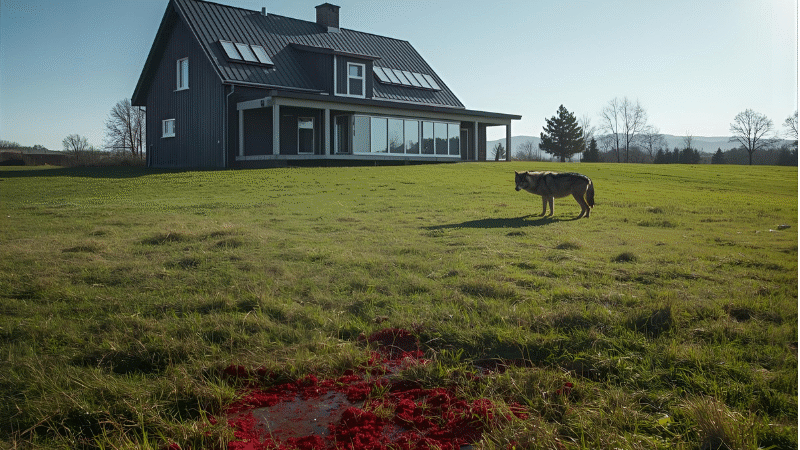

NETD to temat rzeka. Teoretycznie im niższe, tym lepiej. Sensor wykrywa mniejsze różnice temperatur i w obrazie mamy więcej szczegółów tła. W praktyce pomiar zależy od warunków laboratoryjnych, filtrów i czasu integracji. Można „ustawić” test tak, żeby wynik wyglądał świetnie. Dlatego wartości z katalogu nie zawsze przekładają się na realne użytkowanie. Warto więc zwrócić uwagę nie tylko na tu ile milikelwinów ktoś sobie napisał na pudełku, ale w jakij temperaturze je zmierzono. Żeby pokazać prawdziwe osiągi sprzętu najlepiej zrobić pomiar w temperaturze 40-60 C, a żeby udowodnić czy sprzęt nie jest zabawką, wystarczy 30 C. Dobry sprzęt w terenie poznaje się po tym, jak radzi sobie w wilgoci, mgle i przy małych kontrastach termicznych i na dłuższym dystansie. Tu zawsze wyjdzie małe „niedopowiedzienie” w paramtetrach technicznych 😉

Kolejna rzecz to przetwarzanie obrazu. Surowy sygnał z detektora to jedno, ale to co widzi użytkownik, to efekt algorytmów: Kalibracja, poprawa detali, redukcja szumów, zarządzanie dynamiką sceny. W topowych urządzeniach dochodzą systemy bezmigawkowe HSIS, które eliminują „klik” i stabilizują obraz w czasie rzeczywistym. To nie jest detal, tylko realna pomoc w pracy w terenie. W branży widać jasno, że to duzi gracze nadają tempo. Nowe sensory, niższe NETD, lepsze algorytmy, wszystko startuje u nich. Topowe termowizory stosują chociażby automatyczną kontrolę wzmocnienia (AGC), zapewniająca jednorodność obrazu (jednolita skala szarości na tle, zapewniającą przejrzystość, automatyczną regulacja jasności i kontrastu obrazu w celu dostosowania go do otoczenia). Dodatkowo dzięki funkcji DDE szczegółowość obrazu ulega znaczącej poprawie poprzez zwiększenie ostrości obiektu termicznego, oraz redukcji szumów na obrazie 3D DNR.

Czym więc mogą konkurujować mniejsze marki bez własnych podzespołów? Wyświetlaczem, dalmierzem, ergonomią, designem, dodatkowymi funkcjami i ceną. I to jest uczciwe podejście, bowiem nie zatrudniają ogromnego zaplecza inżynierów i naukowców w dziale badawczo rozwojowym. Ale jeśli rdzeń technologii jest starszy, to różnice wyjdą dokładnie wtedy, kiedy sprzęt jest najbardziej potrzebny. Mogą również nieco nagiąć kilka parametrów na papierze, a i tak 99,9% ludzi tego nie sprawdzi, bo nie ma jak. W przypadku wiodących graczy nawet najmniejsze oszustwo w parametrach technicznych to katastrofa wizerunkowa, która może skończyć się fatalnie biznesowo. Kto bowiem będzie chciał kupować komponenty od kogoś, kto nawet nie jest w stanie dotrzymać deklarowanej specyfikacji, a wbrew pozorom rynek taki jest duży, bowiem termowizja jest dziś wszędzie- od kamer cctv, po urządzenia ręczne, a nawet w samochodach…

Na koniec najważniejsze. Nie kupuj oczami tabelki, bo liczby nie polują! Patrz na to, kto stoi za technologią i jak ją rozwija. Bo liczby mogą wyglądać świetnie, ale w łowisku liczy się jedno, kto naprawdę widzi więcej.